Untitled Post

# Um Perigo aos Direitos Humanos: Sistemas de Armas Autônomas e Tomada de Decisão Digital

*Publicado em: 28 de abril de 2025*

*Autor: Brian Stauffer para a Human Rights Watch*

---

## Índice

1. [Introdução](#introducao)

2. [Visão Geral dos Sistemas de Armas Autônomas](#visao-geral-dos-sistemas-de-armas-autonomas)

3. [Implicações para os Direitos Humanos](#implicacoes-para-os-direitos-humanos)

- [Direito à Vida](#direito-a-vida)

- [Direito de Reunião Pacífica](#direito-de-reuniao-pacifica)

- [Dignidade Humana](#dignidade-humana)

- [Não Discriminação](#nao-discriminacao)

- [Direito à Privacidade](#direito-a-privacidade)

- [Direito a Reparação](#direito-a-reparacao)

4. [A Interseção com a Cibersegurança](#a-intersecao-com-a-ciberseguranca)

- [Tomada de Decisão Digital](#tomada-de-decisoes-digital)

- [Ameaças Cibernéticas e Sistemas Autônomos](#ameacas-ciberneticas-e-sistemas-autonomos)

5. [Exemplos e Estudos de Caso do Mundo Real](#exemplos-e-estudos-de-caso-do-mundo-real)

6. [Passo a Passo Técnico: Análise de Sistemas Autônomos com Ferramentas de Cibersegurança](#passo-a-passo-tecnico-analise-de-sistemas-autonomos-com-ferramentas-de-ciberseguranca)

- [Varrendo Sistemas Autônomos com Bash](#varrendo-sistemas-autonomos-com-bash)

- [Analisando a Saída com Python](#analisando-a-saida-com-python)

7. [Do Básico ao Avançado: Implementando Medidas de Cibersegurança](#do-basico-ao-avancado-implementando-medidas-de-ciberseguranca)

- [Varredura de Rede Básica](#varredura-de-rede-basica)

- [Análise e Remediação Avançadas](#analise-e-remediacao-avancadas)

8. [Política, Regulação e o Futuro da Tomada de Decisão Digital](#politica-regulacao-e-o-futuro-da-tomada-de-decisao-digital)

9. [Conclusão](#conclusao)

10. [Referências](#referencias)

---

## Introdução

Em uma era em que a tomada de decisão digital e os sistemas autônomos desempenham um papel cada vez mais proeminente, as implicações do uso de sistemas de armas autônomas (SAA) sobre os direitos humanos vêm recebendo intensa atenção. Este artigo, inspirado no relatório da Human Rights Watch “Um Perigo aos Direitos Humanos: Sistemas de Armas Autônomas e Tomada de Decisão Digital”, examina como esses sistemas — impulsionados por inteligência artificial e decisões algorítmicas — desafiam princípios e obrigações de direitos humanos há muito estabelecidos. Com foco tanto em insights técnicos quanto em análise de políticas, este texto foi concebido para leitores que vão de iniciantes em cibersegurança a profissionais avançados interessados na interseção entre IA, aprendizado de máquina e emprego de força automatizada.

Neste post, exploramos:

- A evolução e as principais características dos SAA.

- Como os SAA podem infringir direitos fundamentais, incluindo o direito à vida, reunião pacífica, dignidade humana, não discriminação, privacidade e o direito a reparação.

- Os aspectos de cibersegurança ligados aos processos de tomada de decisão digital inerentes a esses sistemas.

- Exemplos do mundo real que demonstram vulnerabilidades de cibersegurança em sistemas autônomos.

- Exemplos práticos de código que mostram como escanear pegadas digitais e analisar saídas de sistemas usando Bash e Python.

Por meio desta análise detalhada, esperamos fomentar maior compreensão sobre os perigos representados pelos sistemas de armas autônomas e incentivar discussões mais amplas sobre a criação de medidas regulatórias que priorizem o controle humano significativo.

---

## Visão Geral dos Sistemas de Armas Autônomas

Sistemas de armas autônomas são projetados para selecionar e engajar alvos com pouca ou nenhuma intervenção humana. Baseando-se em sensores, inteligência artificial e algoritmos complexos, esses sistemas têm potencial para funcionar tanto em operações de guerra quanto em tempos de paz, incluindo policiamento. A convicção por trás de seu desenvolvimento gira em torno da promessa de decisões mais “eficientes”; entretanto, o custo é alto quando essas decisões resultam em questões de vida ou morte sem a supervisão crítica do julgamento humano.

Características-chave incluem:

- **Identificação Automática de Alvos:** Uso de dados de sensores e reconhecimento de padrões para identificar alvos.

- **Tomada de Decisão Digital:** Utilização de algoritmos e IA para processar fluxos complexos de dados de campo de batalha.

- **Interação Humana Limitada:** Sistema concebido para limitar, ou até remover, intervenção humana em momentos críticos de decisão.

Embora a ambição dos SAA seja reduzir baixas ou aumentar a eficiência operacional, esses sistemas introduzem riscos que desafiam as normas estabelecidas de direitos humanos e ética na guerra.

---

## Implicações para os Direitos Humanos

Sistemas de armas autônomas se cruzam com numerosos princípios de direitos humanos. A seguir, desmembramos como esses sistemas podem minar direitos reconhecidos internacionalmente.

### Direito à Vida

O direito à vida é fundamental no direito internacional dos direitos humanos. Ele determina que o uso de força letal só é justificável como último recurso e deve sempre respeitar necessidade e proporcionalidade. Os SAA são inerentemente incapazes de:

- Avaliar com precisão nuances ou contextos que determinariam se o uso da força letal é legítimo.

- Comunicar-se com um alvo para desescalar ou dissipar um potencial conflito.

- Adaptar-se em tempo real a circunstâncias imprevistas que exijam julgamento exclusivamente humano.

Consequentemente, a confiança nesses sistemas arrisca privar a vida de forma arbitrária, violando o arcabouço jurídico internacional.

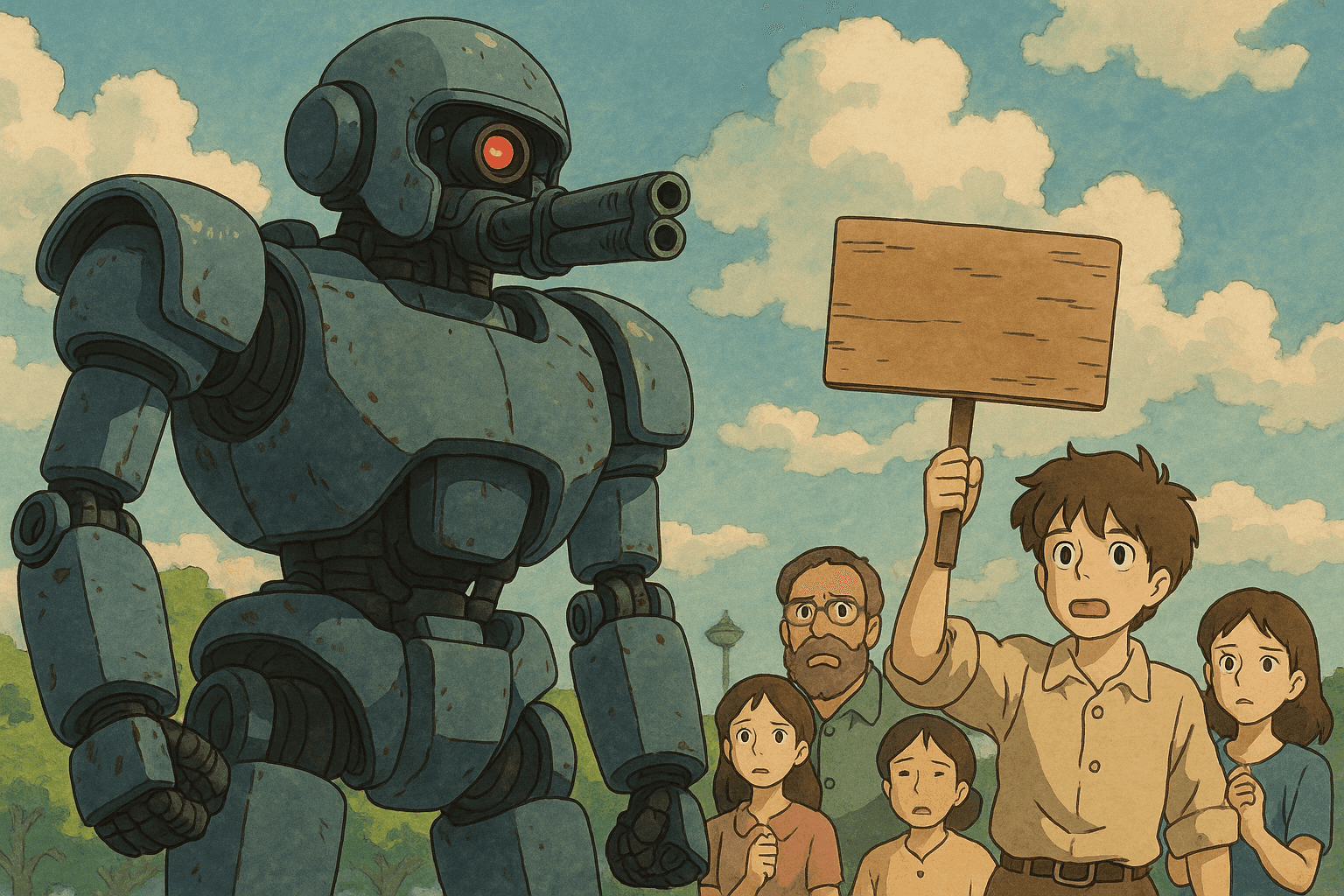

### Direito de Reunião Pacífica

Em sociedades democráticas, o direito de reunião é indispensável; sustenta a livre expressão e a dissidência coletiva. A implantação de SAA em situações de policiamento — onde protestos pacíficos são comuns — pode:

- Levar a julgamentos errôneos em que manifestantes não violentos sejam identificados como ameaças.

- Gerar efeito inibidor ao instaurar medo de força desproporcional, apoiada por máquinas incapazes de julgamento contextual.

- Interferir em processos democráticos centrais e na liberdade de expressão.

### Dignidade Humana

A dignidade humana é a pedra angular de todos os direitos humanos. O processo decisório dos SAA, reduzido a algoritmos computacionais, incapacita o sistema de respeitar o valor intrínseco de cada vida humana. Automatizar decisões de vida ou morte:

- Reduz indivíduos a pontos de dados.

- Desumaniza as vítimas ao tratá-las como meros alvos dentro de algoritmos.

- Falha em compreender a profunda significância da vida humana, infringindo o princípio da dignidade.

### Não Discriminação

O viés algorítmico é questão bem documentada na IA. SAA, se projetados ou implantados sem salvaguardas adequadas, podem perpetuar discriminação sistêmica:

- Vieses conscientes ou inconscientes de desenvolvedores podem ser embutidos nos dados de treinamento.

- Processos decisórios opacos em “caixa-preta” dificultam responsabilizar sistema ou criadores.

- Grupos vulneráveis e marginalizados podem ser desproporcionalmente visados, minando equidade e igualdade.

### Direito à Privacidade

O desenvolvimento e a implantação de SAA estão intimamente ligados a extensas operações de vigilância. As fases de teste e treinamento desses sistemas exigem coleta massiva de dados:

- Dados pessoais podem ser reunidos durante treinamento e operação, violando direitos individuais de privacidade.

- Medidas de vigilância extensivas e muitas vezes desnecessárias podem ser empregadas, ferindo princípios de necessidade e proporcionalidade.

- Tais práticas criam ambiente de vigilância digital pervasiva que põe em risco a privacidade de indivíduos globalmente.

### Direito a Reparação

Quando direitos são violados, o direito a reparação garante mecanismos de responsabilização e compensação. Com SAA:

- Algoritmos de “caixa-preta” tornam difícil apontar a responsabilidade por ações ilegais.

- Fica complicado assegurar responsabilidade criminal ou mesmo reparação civil quando decisões são tomadas por máquinas.

- Essa lacuna de responsabilização enfraquece os mecanismos criados para corrigir violações de direitos humanos.

---

## A Interseção com a Cibersegurança

Como sistemas de armas autônomas dependem fortemente de tomada de decisão digital, eles naturalmente se cruzam com preocupações de cibersegurança. Sistemas mal protegidos sofrem risco de manipulação externa, o que pode ter resultados catastróficos quando integrado a capacidade letal.

### Tomada de Decisões Digital

A tomada de decisão digital nos SAA envolve algoritmos que analisam dados de sensores — muitas vezes de uma rede interconectada — para determinar necessidade e proporcionalidade de força. Essa espinha dorsal digital introduz diversos desafios de cibersegurança:

- **Integridade de Dados:** Garantir que os dados inseridos no processo decisório sejam seguros e não alterados.

- **Resiliência do Sistema:** Proteger contra invasões, falhas de sistema e mau funcionamento de sensores.

- **Transparência e Responsabilização:** Superar a natureza “caixa-preta” de IA sofisticada, que obscurece como e por que as decisões são tomadas.

### Ameaças Cibernéticas e Sistemas Autônomos

Os riscos de cibersegurança específicos aos SAA incluem:

- **Malware e Invasões:** Atores não autorizados podem infiltrar-se para assumir controle ou alterar algoritmos decisórios.

- **Falsificação de Dados (Spoofing):** Dados falsos ou manipulados podem desencadear engajamentos indevidos, comprometendo a distinção entre combatentes e civis.

- **Ataques de Negação de Serviço (DoS):** Tentativas de sobrecarregar a rede ou sistema, levando a falhas operacionais em momentos críticos.

Tais vulnerabilidades enfatizam a necessidade de medidas robustas de cibersegurança na criação e uso de SAA.

---

## Exemplos e Estudos de Caso do Mundo Real

Embora a implementação de armas totalmente autônomas ainda seja limitada, há casos notáveis em que elementos de tomada de decisão digital influenciaram operações reais:

1. **Sistemas de Defesa Perimetral:**

Alguns sistemas modernos de vigilância de fronteira utilizam rotinas automatizadas de reconhecimento e decisão. Em um caso, sensores confundiram grupo de manifestantes pacíficos com rede de contrabando, gerando uso de força desnecessário.

2. **Drones Policiais em Áreas Urbanas:**

Em “cidades inteligentes”, drones equipados com reconhecimento facial e rastreamento automático são usados pelas forças de segurança. Apesar da intenção de prevenir crimes, levantam preocupações sobre vigilância em massa, invasão de privacidade e alvos errôneos devido a vieses algorítmicos.

3. **Vulnerabilidades em Ciberataques:**

Em jogos de guerra cibernéticos, equipes de hackers conseguiram injetar código malicioso em protótipo de SAA, demonstrando quão facilmente sistemas de decisão digital podem ser subvertidos por ameaças cibernéticas.

Esses exemplos destacam a natureza de uso dual da tecnologia de decisão digital: vantagens operacionais coexistem com riscos de violações graves de direitos humanos se não houver regulação.

---

## Passo a Passo Técnico: Análise de Sistemas Autônomos com Ferramentas de Cibersegurança

Compreender e analisar a postura de cibersegurança de sistemas autônomos exige prática. Abaixo, fornecemos exemplos de código e guias técnicos que ilustram como profissionais podem identificar vulnerabilidades e analisar saídas.

### Varrendo Sistemas Autônomos com Bash

Um dos primeiros passos para avaliar a segurança de uma rede de SAA é realizar varredura. Veja exemplo de script usando Nmap:

```bash

#!/bin/bash

# Script: aws_network_scan.sh

# Propósito: Varredura em um sistema autônomo para detectar portas abertas e serviços

# Uso: ./aws_network_scan.sh <ip_alvo>

if [ "$#" -ne 1 ]; then

echo "Uso: $0 <ip_alvo>"

exit 1

fi

IP_ALVO=$1

echo "Iniciando varredura de rede em $IP_ALVO..."

/usr/bin/nmap -sV -T4 -oN resultado_scan.txt $IP_ALVO

echo "Varredura concluída. Resultados salvos em resultado_scan.txt"

Explicação:

- O script verifica se o número de argumentos está correto.

- Chama o Nmap com

-sV(detectar versões de serviço),-T4(execução mais rápida) e exporta resultados. - O arquivo gerado pode ser processado posteriormente para extrair detalhes sobre possíveis vulnerabilidades.

Analisando a Saída com Python

Após a varredura, o analista pode precisar processar os resultados com Python:

#!/usr/bin/env python3

"""

Script: parse_scan_results.py

Propósito: Analisar saída do Nmap e extrair portas abertas e serviços.

Uso: python3 parse_scan_results.py resultado_scan.txt

"""

import sys

import re

def parse_nmap_output(caminho_arquivo):

portas_abertas = []

with open(caminho_arquivo, 'r') as arquivo:

for linha in arquivo:

# Padrão regex para capturar portas abertas (formato padrão Nmap)

match = re.search(r'^(\d+)/tcp\s+open\s+(\S+)', linha)

if match:

porta, servico = match.groups()

portas_abertas.append({'porta': porta, 'servico': servico})

return portas_abertas

def exibir_resultados(portas_abertas):

if portas_abertas:

print("Portas abertas e seus serviços:")

for entrada in portas_abertas:

print(f"Porta: {entrada['porta']} | Serviço: {entrada['servico']}")

else:

print("Nenhuma porta aberta detectada ou não foi possível analisar.")

if __name__ == "__main__":

if len(sys.argv) != 2:

print("Uso: python3 parse_scan_results.py <resultado_scan.txt>")

sys.exit(1)

caminho = sys.argv[1]

portas = parse_nmap_output(caminho)

exibir_resultados(portas)

Explicação:

- Usa expressão regular para identificar linhas com informações de portas.

- Armazena detalhes em lista de dicionários.

- Exibe as informações para análise manual ou relatórios automatizados.

Do Básico ao Avançado: Implementando Medidas de Cibersegurança

Garantir a segurança e conformidade de sistemas autônomos requer abordagem em camadas.

Varredura de Rede Básica

Para iniciantes:

- Entenda Fundamentos de Redes: Protocolos TCP/IP, modelo OSI, portas comuns.

- Ferramentas como Nmap: Pratique escaneamento de redes locais ou remotas.

- Customização de Scripts: Aprimore scripts Bash conforme necessidade.

Dica: use laboratórios virtuais (VirtualBox, Docker) para testes sem risco.

Análise e Remediação Avançadas

Para profissionais avançados:

- Inspeção Profunda de Pacotes (DPI): Wireshark para análise em tempo real.

- Gerenciamento Automatizado de Vulnerabilidades: Monitoramento contínuo de SAA.

- Integração com SIEM: Centralize logs e alertas.

- Segurança Baseada em IA: Machine learning para detecção de anomalias.

- Auditorias Regulares: Algoritmos de decisão e ambiente de rede revisados periodicamente.

Política, Regulação e o Futuro da Tomada de Decisão Digital

Além dos desafios técnicos, é crucial estabelecer políticas que assegurem controle humano significativo. Objetivos‐chave:

- Proibir Autonomia Irrestrita: Banir sistemas que operam sem supervisão humana significativa.

- Garantir Responsabilização: Definir responsabilidade por ações ilegais dos SAA.

- Transparência Algorítmica: Exigir escrutínio dos algoritmos para evitar vieses.

- Tratados Internacionais: Apoiar esforços multilatéricos (CCW, Campanha Stop Killer Robots).

- IA Ética: Pesquisas que priorizem valores humanos desde o design do sistema.

A decisão digital é mais que desafio técnico — é encruzilhada moral para o futuro da guerra e da segurança pública.

Conclusão

Sistemas de armas autônomas, impulsionados por decisões digitais sofisticadas, representam paradoxo tecnológico: prometem eficiência, mas apresentam grandes riscos a direitos fundamentais. Comprometem desde o direito à vida até a privacidade, podendo instaurar vigilância digital em massa.

Neste texto:

- Analisamos os direitos ameaçados pelos SAA.

- Oferecemos insights técnicos para integrar cibersegurança à tomada de decisão digital.

- Fornecemos exemplos práticos, estudos de caso e amostras de código.

- Discutimos importância de políticas robustas para garantir controle humano e conformidade jurídica.

À medida que a tecnologia avança, a responsabilidade de garantir que sirva à humanidade permanece primordial. Somente por meio de controle humano significativo e práticas rigorosas de cibersegurança podemos evitar que a promessa da tecnologia autônoma se torne um perigo aos direitos humanos.

Referências

- Human Rights Watch. “Um Perigo aos Direitos Humanos: Sistemas de Armas Autônomas e Tomada de Decisão Digital.”

- International Human Rights Clinic, Harvard Law School. “Shaking the Foundations: The Human Rights Implications of Killer Robots.”

- Convenção sobre Certas Armas Convencionais (CCW).

Recursos técnicos adicionais:

- Documentação oficial do Nmap: https://nmap.org/book/

- Documentação do Wireshark: https://www.wireshark.org/docs/

Ao combinar análise de políticas com técnicas reais de cibersegurança, podemos aprofundar a compreensão das dimensões técnicas e éticas dos sistemas de armas autônomas. A vigilância coletiva é essencial para garantir que a tecnologia esteja alinhada com os princípios da dignidade humana e dos direitos humanos.

Leve Sua Carreira em Cibersegurança para o Próximo Nível

Se você achou este conteúdo valioso, imagine o que você poderia alcançar com nosso programa de treinamento de elite abrangente de 47 semanas. Junte-se a mais de 1.200 alunos que transformaram suas carreiras com as técnicas da Unidade 8200.