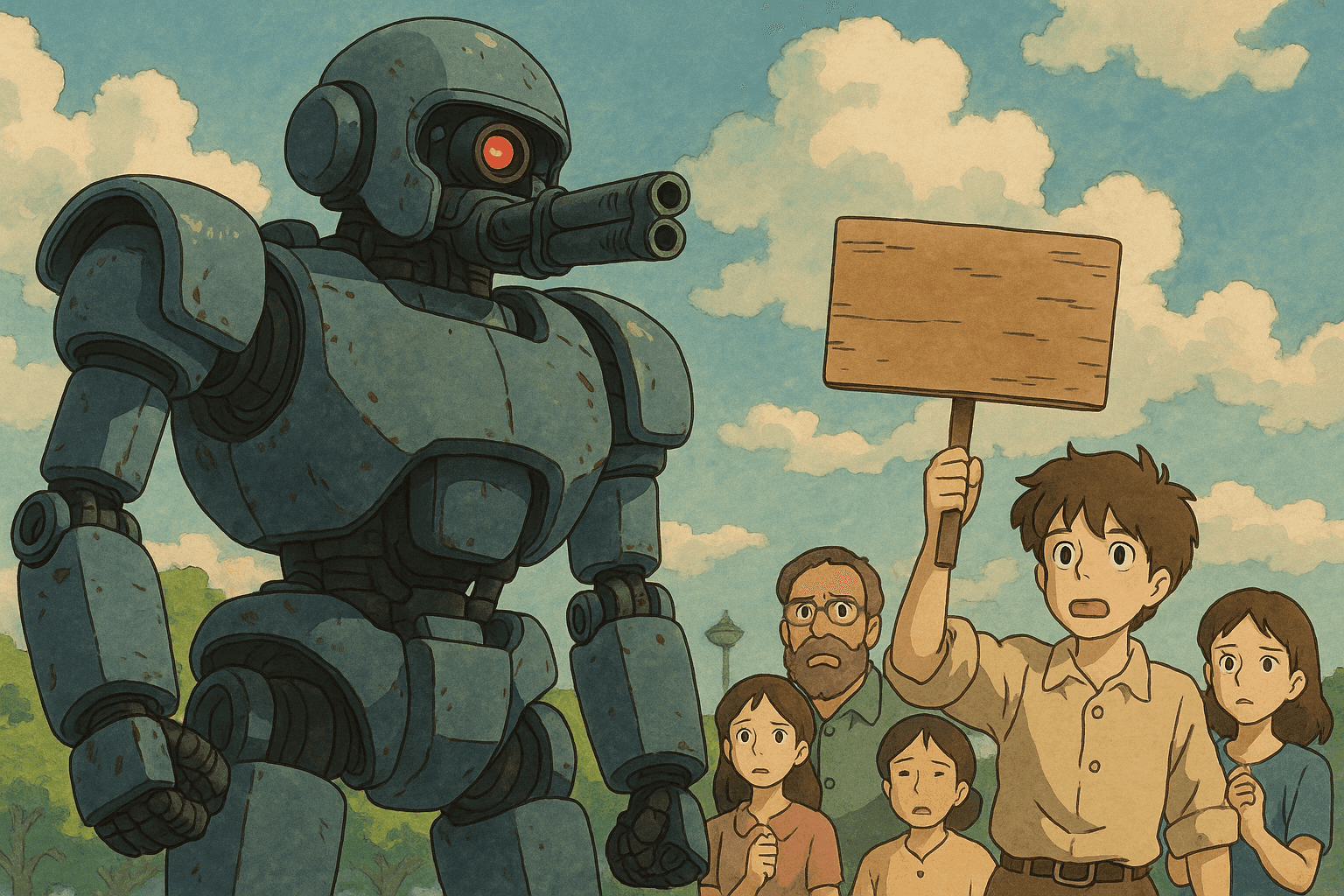

自主武器系统危害分析

自主武器系统,或称“杀手机器人”,对生命权、尊严权、隐私权及和平集会权等人权构成重大威胁。本报告由人权观察撰写,批判其与国际人权法的不相容性。

# 人权的危险:自主武器系统与数字化决策

*发布日期:2025 年 4 月 28 日*

*作者:Brian Stauffer(代表人权观察)*

---

## 目录

1. [引言](#introduction)

2. [自主武器系统概述](#overview-of-autonomous-weapons-systems)

3. [人权影响](#human-rights-implications)

- [生命权](#right-to-life)

- [和平集会权](#right-to-peaceful-assembly)

- [人类尊严](#human-dignity)

- [不歧视原则](#non-discrimination)

- [隐私权](#right-to-privacy)

- [救济权](#right-to-remedy)

4. [与网络安全的交汇](#the-intersection-with-cybersecurity)

- [数字化决策](#digital-decision-making)

- [网络威胁与自主系统](#cyber-threats-and-autonomous-systems)

5. [现实示例与案例研究](#real-world-examples-and-case-studies)

6. [技术演练:借助网络工具分析自主系统](#technical-walkthrough-autonomous-systems-analysis-using-cyber-tools)

- [使用 Bash 扫描自主系统](#scanning-autonomous-systems-with-bash)

- [使用 Python 解析与分析输出](#parsing-and-analyzing-output-with-python)

7. [从入门到进阶:实施网络安全措施](#from-beginner-to-advanced-implementing-cybersecurity-measures)

- [基础网络扫描](#basic-network-scanning)

- [高级分析与补救](#advanced-analysis-and-remediation)

8. [政策、监管与数字化决策的未来](#policy-regulation-and-the-future-of-digital-decision-making)

9. [结论](#conclusion)

10. [参考文献](#references)

---

## Introduction

<a name="introduction"></a>

在数字化决策和自主系统日益凸显的时代,自主武器系统(Autonomous Weapons Systems,简称 AWS)对人权的影响引发了广泛关注。本文参考人权观察报告《人权的危险:自主武器系统与数字化决策》,探讨由人工智能和算法驱动的这些系统如何挑战人权原则与义务。文章兼顾技术洞见与政策分析,适合网络安全入门者和关注 AI、机器学习及自动化武力部署的专业人士阅读。

本文将讨论:

- AWS 的演进与基本特征;

- AWS 如何侵害生命权、和平集会权、人类尊严、不歧视、隐私权以及救济权;

- 数字化决策所带来的网络安全问题;

- 自主系统在真实世界中的网络安全漏洞案例;

- 通过 Bash 与 Python 扫描数字足迹、解析系统输出的实用代码示例。

我们希望通过深入讨论,增进公众对自主武器系统危险性的理解,并推动建立确保“有效人为控制”的监管措施。

---

## Overview of Autonomous Weapons Systems

<a name="overview-of-autonomous-weapons-systems"></a>

自主武器系统旨在在极少或无人工干预的情况下,自主选择并攻击目标。它们依赖传感器、人工智能与复杂算法,可用于战时和和平时期(如执法)。开发者声称此类系统能提升“效率”,但当决策关乎生死却缺乏关键的人类判断时,代价极其高昂。

主要特征包括:

- **自动化目标识别**:依靠传感器数据与模式识别确定目标;

- **数字化决策**:利用算法和 AI 处理复杂战场数据流;

- **有限的人类交互**:在关键决策瞬间限制甚至取消人为干预。

虽然 AWS 的目标是减少伤亡或提高作战效率,但它们带来的风险已对人权与伦理战争规范提出严峻挑战。

---

## Human Rights Implications

<a name="human-rights-implications"></a>

自主武器系统与多项人权原则交织。以下分项阐述其潜在侵害。

### Right to Life

<a name="right-to-life"></a>

生命权是国际人权法的核心。只有在“最后手段”且遵守必要性与比例性的情况下方可使用致命武力。AWS 天生无法:

- 精确评估细微线索或情境,以判断致命武力是否正当;

- 与目标沟通以缓和或化解冲突;

- 在突发情况中作出需要人类判断的实时调整。

因此,依赖 AWS 可能导致武断剥夺生命,违反国际法律框架。

### Right to Peaceful Assembly

<a name="right-to-peaceful-assembly"></a>

在民主社会,集会权不可或缺。若将 AWS 用于执法:

- 可能将非暴力示威者误判为威胁;

- 机器可能采取不成比例的武力,从而产生“寒蝉效应”;

- 破坏民主进程和表达自由。

### Human Dignity

<a name="human-dignity"></a>

人类尊严是所有人权的基石。AWS 的决策被简化为冷冰冰的计算:

- 将个体简化为数据点;

- 使受害者非人化,仅被算法视为“目标”;

- 无法理解生命的重大意义,从而侵犯人类尊严。

### Non-Discrimination

<a name="non-discrimination"></a>

算法偏见早有定论。若缺乏充分防护,AWS 可能延续并放大系统性歧视:

- 开发人员的偏见会写入训练数据;

- “黑箱”决策过程难以追责;

- 弱势群体可能被过度瞄准,侵蚀公平与平等。

### Right to Privacy

<a name="right-to-privacy"></a>

AWS 的开发与部署通常伴随大规模监视:

- 系统训练和运行需要收集大量个人数据;

- 可能采用广泛且不必要的监控措施,违反必要性与比例性原则;

- 全球范围内的数字监控环境威胁个人隐私。

### Right to Remedy

<a name="right-to-remedy"></a>

权利受侵害时,救济权保证问责与赔偿。然而:

- “黑箱”算法使确定责任归属困难;

- 机器作出的决策难以追究刑事或民事责任;

- 问责缺口削弱纠正或补偿人权侵害的机制。

---

## The Intersection with Cybersecurity

<a name="the-intersection-with-cybersecurity"></a>

AWS 的数字化决策高度依赖网络系统,若安全不足,外部操纵可导致灾难性后果。

### Digital Decision-Making

<a name="digital-decision-making"></a>

AWS 的算法需分析传感器数据,以决定武力使用的必要性与比例性。其网络安全挑战包括:

- **数据完整性**:确保输入数据安全、未被篡改;

- **系统韧性**:防止黑客入侵、系统故障与传感器失灵;

- **透明与问责**:突破 AI “黑箱”带来的决策不透明。

### Cyber Threats and Autonomous Systems

<a name="cyber-threats-and-autonomous-systems"></a>

AWS 特有的网络风险:

- **恶意软件与黑客攻击**:非法入侵可劫持或修改决策算法;

- **数据欺骗**:伪造或篡改数据可能导致误杀;

- **拒绝服务(DoS)**:瘫痪网络或系统,在关键时刻导致失效。

这些漏洞强调在开发与部署 AWS 时整合强大网络防护的重要性。

---

## Real-World Examples and Case Studies

<a name="real-world-examples-and-case-studies"></a>

尽管完全自主武器的实际部署仍有限,但已有部分数字化决策影响真实行动的案例:

1. **边境周界防御系统**

某些现代边境监控系统使用自动识别与决策流程。某次系统误将和平抗议者识别为走私团伙,导致过度武力部署,暴露非人类判断的局限。

2. **城市执法无人机**

智慧城市中,执法机构使用配备人脸识别与自动跟踪的无人机。本意在防范犯罪,却引发大规模监控、隐私侵害与算法歧视。

3. **网络攻防演练漏洞**

在一次网络攻防演习中,红队成功向 AWS 原型注入恶意代码,显示数字化决策系统在网络威胁面前的脆弱性。

这些案例展示了数字化决策技术的双重用途:既有运营优势,也可引发严重人权风险。

---

## Technical Walkthrough: Autonomous Systems Analysis Using Cyber Tools

<a name="technical-walkthrough-autonomous-systems-analysis-using-cyber-tools"></a>

了解并分析自主系统的网络安全状况需要动手实践。本节提供代码示例,演示如何扫描漏洞并解析输出。

### Scanning Autonomous Systems with Bash

<a name="scanning-autonomous-systems-with-bash"></a>

以下 Bash 脚本利用 Nmap 对目标 IP 进行端口与服务扫描。

```bash

#!/bin/bash

# 脚本:aws_network_scan.sh

# 作用:扫描自主系统开放端口与运行服务

# 用法:./aws_network_scan.sh <目标_IP>

if [ "$#" -ne 1 ]; then

echo "用法: $0 <目标_IP>"

exit 1

fi

TARGET_IP=$1

echo "开始扫描 $TARGET_IP ..."

/usr/bin/nmap -sV -T4 -oN scan_results.txt $TARGET_IP

echo "扫描完成。结果已保存至 scan_results.txt"

说明

- 检查参数数量;

- 使用

-sV获取服务版本,-T4提速,并将结果输出到文件; - 后续可对输出进行解析,定位不安全端口或服务。

Parsing and Analyzing Output with Python

扫描完毕后,可借助 Python 解析输出并提取开放端口与服务。

#!/usr/bin/env python3

"""

脚本:parse_scan_results.py

作用:解析 Nmap 输出,提取开放端口与服务信息

用法:python3 parse_scan_results.py scan_results.txt

"""

import sys

import re

def parse_nmap_output(file_path):

open_ports = []

with open(file_path, 'r') as file:

for line in file:

# 利用正则解析标准 Nmap 输出中的开放端口

match = re.search(r'^(\d+)/tcp\s+open\s+(\S+)', line)

if match:

port, service = match.groups()

open_ports.append({'port': port, 'service': service})

return open_ports

def display_results(open_ports):

if open_ports:

print("开放端口及其服务列表:")

for entry in open_ports:

print(f"端口: {entry['port']} | 服务: {entry['service']}")

else:

print("未检测到开放端口或无法解析信息。")

if __name__ == "__main__":

if len(sys.argv) != 2:

print("用法: python3 parse_scan_results.py <scan_results.txt>")

sys.exit(1)

file_path = sys.argv[1]

open_ports = parse_nmap_output(file_path)

display_results(open_ports)

说明

- 使用正则表达式匹配端口信息;

- 将端口与服务存入字典列表;

- 输出结果供人工审查或自动化报告。

From Beginner to Advanced: Implementing Cybersecurity Measures

保障 AWS 的安全与人权合规需分层防护。

Basic Network Scanning

入门建议:

- 掌握网络基础:学习 TCP/IP、OSI 模型及常见端口;

- 使用 Nmap:扫描本地或远程网络寻找漏洞;

- 脚本自定义:通过 Bash 脚本提升效率。

提示:在 VirtualBox、Docker 等虚拟环境中练习,避免影响真实系统。

Advanced Analysis and Remediation

进阶实践:

- 深度包检测 (DPI):利用 Wireshark 实时分析流量;

- 自动化漏洞管理:持续监测 AWS 异常或未授权访问;

- 融合 SIEM:将扫描结果与日志对接 SIEM 平台;

- AI 安全防护:应用机器学习进行异常检测与预测;

- 定期审计:审查算法与网络环境,发现盲区。

Policy, Regulation, and the Future of Digital Decision-Making

技术难题需配合政策与法规:

- 禁止无约束自主能力:立法禁止无“有效人为控制”的杀伤系统;

- 落实责任追究:明确开发者、操作者、制造商的法律责任;

- 算法透明:要求算法可审查,防止偏见;

- 国际条约与合作:在《常规武器公约》等框架内协作;

- 融入伦理 AI:在设计阶段纳入伦理考量,确保技术服务人类价值。

Conclusion

自主武器系统以数字化决策为驱动,模糊了效率与人权风险的界限:

- 可能侵害生命权、和平集会权、尊严与隐私;

- 演示了网络安全在保障数字化决策安全中的关键作用;

- 通过示例与代码,展示了扫描、解析及补救路径;

- 强调了政策与监管对确保道德与法律合规的重要性。

科技再先进,也必须服务于人类。唯有集结安全专业人士、政策制定者、技术开发者与公民社会,才能确保自主技术不成为人权危机。

References

- Human Rights Watch. 《人权的危险:自主武器系统与数字化决策》.

- Harvard Law School’s International Human Rights Clinic. 《动摇根基:杀手机器人的人权影响》.

- Convention on Certain Conventional Weapons (CCW).

技术资源:

- Nmap 官方文档: https://nmap.org/book/

- Wireshark 官方文档: https://www.wireshark.org/docs/