生成式人工智能的四种欺骗类型

Judith Simon 探讨了生成式人工智能在伦理和认识论上的伤害,指出四种欺骗类型:误导身份、夸大能力、欺骗内容以及整合引发的误解。她呼吁审查人工智能可信度并强调开发者责任。

# 生成式 AI 与四重欺骗:面向网络安全的综合技术探索

*2025 年 8 月 29 日发布,作者 Judith Simon*

自 2022 年秋季以来,生成式 AI 迅速席卷全球。数以百万计的活跃用户、数十亿次请求以及日益扩大的社会影响,使得生成式 AI 不仅重新定义了创造性表达,也带来了错综复杂的伦理与知识论挑战。在这篇长篇技术博客中,我们探讨生成式 AI 现象,拆解其所带来的“四重欺骗”,并讨论这些趋势与网络安全的交汇。文章内容涵盖从入门概念到高级技术应用、真实案例,甚至包含 Bash 与 Python 代码示例,帮助安全从业者理解并缓解新兴威胁。

---

## 目录

1. [引言](#引言)

2. [理解生成式 AI](#理解生成式-ai)

- [什么是生成式 AI?](#什么是生成式-ai)

- [底层机制](#底层机制)

3. [四重欺骗:四种截然不同的形式](#四重欺骗四种截然不同的形式)

- [1. 本体地位欺骗](#1-本体地位欺骗)

- [2. 能力误导](#2-能力误导)

- [3. 生成内容欺骗](#3-生成内容欺骗)

- [4. 集成与功能层面的欺骗](#4-集成与功能层面的欺骗)

4. [生成式 AI 与网络安全](#生成式-ai-与网络安全)

- [AI 在现代网络安全中的用法](#ai-在现代网络安全中的用法)

- [双刃剑:生成式 AI 的攻防两面](#双刃剑生成式-ai-的攻防两面)

5. [实践篇:扫描与解析](#实践篇扫描与解析)

- [入门级:使用 Bash 进行网络扫描](#入门级使用-bash-进行网络扫描)

- [进阶级:用 Python 解析扫描输出](#进阶级用-python-解析扫描输出)

6. [AI 驱动的欺骗与网络攻击实例](#ai-驱动的欺骗与网络攻击实例)

7. [伦理影响与缓解策略](#伦理影响与缓解策略)

8. [结论与未来方向](#结论与未来方向)

9. [参考文献](#参考文献)

---

## 引言

生成式 AI 指一类通过学习海量数据模式来生成新内容(文本、图像、音频乃至视频)的高级算法。从栩栩如生的深度伪造到接近人类水平的文字段落,这些技术能以惊人的准确率模仿人类创造力。然而,能力越大,风险也越大;生成式 AI 引入的多重欺骗足以动摇个人乃至系统层面的信任。

本文探讨生成式 AI 所带来的四种截然不同的欺骗类型,不仅分析其伦理与知识论含义,还评估其对网络安全的潜在影响。文章跨越哲学与技术两大领域,为安全专家与技术人员提供理解并缓解 AI 驱动新威胁的实践指南。

---

## 理解生成式 AI

### 什么是生成式 AI?

生成式 AI 是人工智能的一个子领域,核心在于“创造”内容,而非仅做分类或预测。常见技术包括:

- **深度学习**与 *Transformer* 架构(例如 GPT 系列)

- **变分自编码器(VAE)**

- **生成对抗网络(GAN)**

模型通过挖掘海量数据中的统计模式(多数来源于网络抓取),并基于概率分布组合出看似连贯且相关的新内容。

### 底层机制

生成式 AI 本质上依赖概率推断:分析大量文档或图像,计算下一个 token 或像素出现的概率。响应查询时,模型“采样”这些概率分布来构建合理输出。正因如此,结果常处于“认知幸运”区间——或许恰好正确,却缺乏客观事实支撑。这既令人着迷,也暗藏欺骗风险。

---

## 四重欺骗:四种截然不同的形式

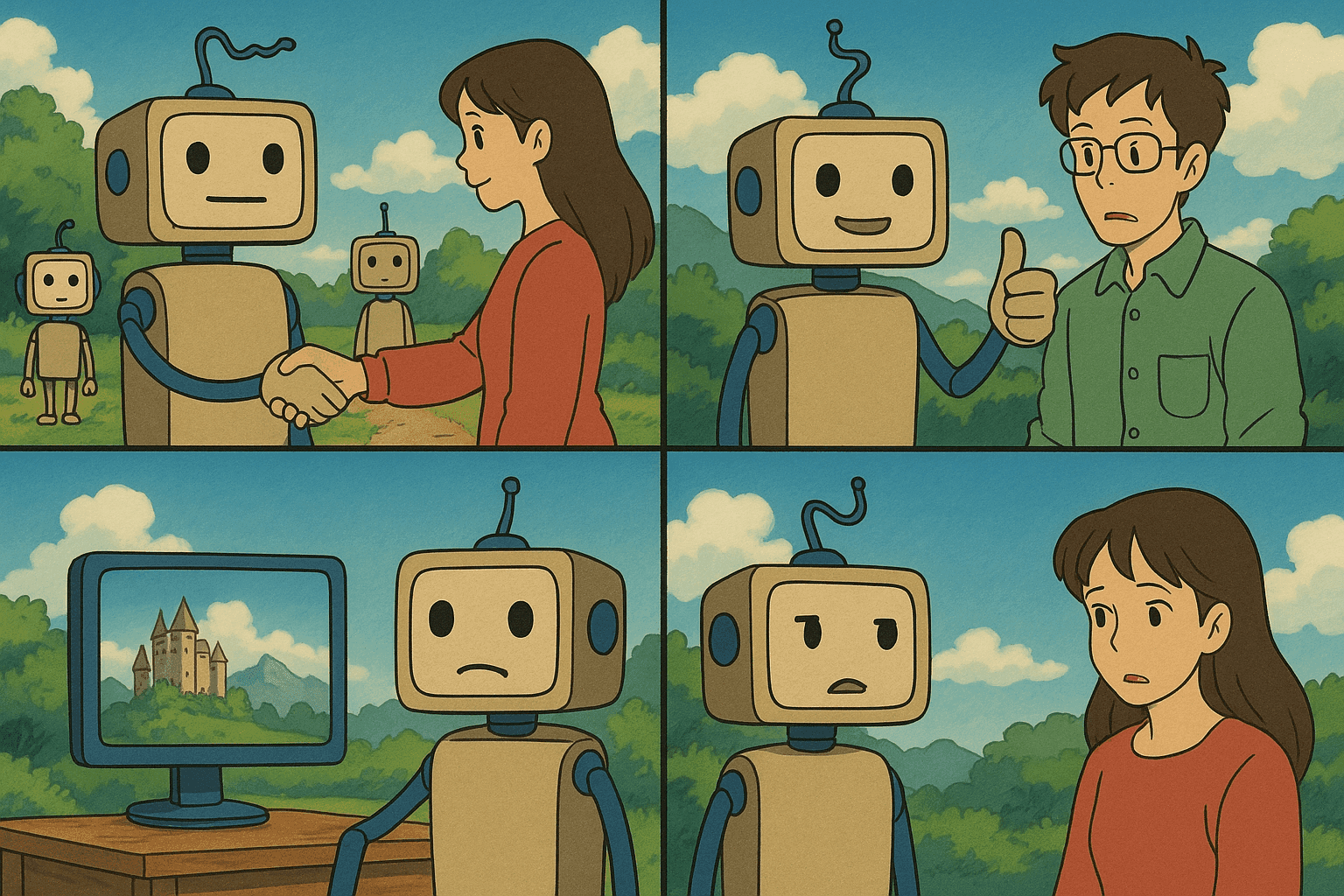

生成式 AI 的普及带来多层次欺骗潜能,本文将其框架化为“四重欺骗”:

1. 有关交互对象本体地位的欺骗

2. 有关 AI 能力的欺骗

3. 通过生成内容实施的欺骗

4. 将生成式 AI 集成到其他软件后产生的欺骗

下面逐一展开。

### 1. 本体地位欺骗

最直观的风险在于用户被误导:以为正在与真人交互,实际上对方是聊天机器人。这种“本体欺骗”早在图灵的模仿游戏中已有雏形。如今,AI 渗透客服、心理治疗等高敏感度场景,误认机器为人所造成的后果更为严重。

### 2. 能力误导

ChatGPT 等工具流行后,一些人声称这些系统具备同理心、理解力,甚至意识。这种拟人化倾向自 Weizenbaum 的 ELIZA 时代便已出现。过度信任或错误估计 AI 能力,可能导致心理或制度层面的严重后果。

### 3. 生成内容欺骗

第三类欺骗源于 AI 生成并传播的误导性内容,例如深度伪造图像、虚假科研论文或煽动性宣传。与传统谣言相比,现代 AI 制作假信息的速度与规模空前,配合社交媒体更具破坏力。

### 4. 集成与功能层面的欺骗

第四类欺骗更隐蔽:当生成式 AI 集成到搜索引擎或客服平台时,其能力被夸大。用户可能误以为 ChatGPT 提供的是经过验证的搜索结果,而模型只是概率匹配,并不保证准确。这对依赖信息可靠性的关键决策场景构成威胁。

---

## 生成式 AI 与网络安全

### AI 在现代网络安全中的用法

传统网络安全依赖特征签名与异常检测;AI 进一步强化这些手段:

- **模式识别**:侦测异常流量、静默设备或用户行为偏差

- **威胁模拟**:生成潜在攻击向量,测试系统韧性

- **自动漏洞扫描**:通过机器学习加速发现漏洞

例如,许多组织已部署 AI 驱动系统,实时监控网络并自动标记可疑活动。

### 双刃剑:生成式 AI 的攻防两面

攻击者亦可利用生成式 AI 制作更逼真的钓鱼邮件、伪装 C2 通信,甚至通过深度伪造劫持信任。举例而言,黑客可生成一封看似 CEO 发出的邮件,诱骗员工转账或泄密。这要求更强大的验证与检测机制。

---

## 实践篇:扫描与解析

本节展示借助生成式 AI 思维增强的传统安全工具链:先用 Bash 进行网络扫描,再用 Python 自动解析结果。

### 入门级:使用 Bash 进行网络扫描

以下 Bash 脚本调用 nmap 扫描目标网络:

```bash

#!/bin/bash

# network_scan.sh - 使用 nmap 的简单网络扫描脚本

# 检查是否传入目标 IP/主机名

if [ -z "$1" ]; then

echo "用法: $0 <目标_IP_或_主机名>"

exit 1

fi

TARGET=$1

OUTPUT_FILE="scan_results.txt"

echo "正在扫描目标: $TARGET"

nmap -v -A $TARGET -oN $OUTPUT_FILE

echo "扫描完成,结果已保存至 $OUTPUT_FILE。"

说明:

-v -A选项启用详细、操作系统与版本检测等功能- 结果输出到

scan_results.txt,方便后续分析

进阶级:用 Python 解析扫描输出

扫描后,需自动化处理结果以快速定位漏洞。示例 Python 脚本如下(假设 nmap 文本输出含 “PORT STATE SERVICE” 行):

#!/usr/bin/env python3

"""

parse_scan.py - 解析 nmap 扫描结果并列出开放端口

"""

import re

def parse_scan_results(filename):

open_ports = []

try:

with open(filename, 'r') as file:

for line in file:

# 例如 "80/tcp open http"

match = re.search(r"(\d+)/tcp\s+open\s+(\S+)", line)

if match:

port = match.group(1)

service = match.group(2)

open_ports.append((port, service))

except FileNotFoundError:

print(f"错误: 未找到文件 {filename}")

return open_ports

if __name__ == '__main__':

results_file = "scan_results.txt"

ports = parse_scan_results(results_file)

if ports:

print("检测到开放端口:")

for port, service in ports:

print(f"- 端口 {port} 运行 {service}")

else:

print("未发现开放端口或扫描数据无效。")

AI 驱动的欺骗与网络攻击实例

政治宣传中的深度伪造

某国政要被伪造的视频迅速走红网络,造成民众恐慌,后经核实为深度伪造。这类事件加剧了选举干预与公共舆论操纵的担忧。

AI 增强型钓鱼攻击

攻击者利用生成式 AI 根据社交媒体数据撰写个性化钓鱼邮件,模仿同事或高管语气。一名员工因此泄露了敏感财务信息。

自动化漏洞发现

防御方使用 AI 快速生成成千上万的代码变体,模拟攻击向量以提前修补漏洞。但这也提示攻击者可反向工程类似技术。

AI 聊天机器人社会工程

用户在危机时期寻求情感支持,却与 AI 聊天机器人互动,并误以为对方是真人同理心。若被恶意利用,可诱导用户泄露隐私或采取危险行为。

伦理影响与缓解策略

伦理困境

- 可信度:误判 AI 的本体地位与能力会带来严重后果

- 责任归属:算法输出导致伤害时,开发者与企业的责任边界模糊

- 社会影响:伪造内容侵蚀公众对媒体与机构的信任

缓解策略

- 透明与可解释性:标注 AI 生成内容,使用数字水印

- 身份验证协议:实施多因素验证,降低冒充风险

- 监管与监测:跨国合作制定行业标准与法规

- 用户教育:普及 AI 局限性与风险意识

- AI 增强的检测:开发自动化工具识别伪造内容与异常活动

结论与未来方向

生成式 AI 是当今最具变革性的技术之一,其生成文本、图像乃至互动对话的能力催生了多重欺骗。本文深入解析“四重欺骗”模型,并将其与网络安全实践结合,提供 Bash 与 Python 示例供安全从业者参考。

面向未来,技术开发者、网络安全专家、政策制定者与普通用户需协同,构建自审计、抗操纵、可验证的 AI 系统。通过透明、伦理的实践及持续升级的安全措施,我们才能在享受 AI 益处的同时,将风险降至最低。

参考文献

这篇文章跨越哲学与网络安全两个领域,旨在为面对 AI 驱动欺骗的未来提供思考与工具。欢迎分享您的观点、订阅更新,或深入阅读相关链接。让我们携手共建更安全、更可信的数字世界。